Ollama veilig installeren: stappenplan voor lokale LLMs

- JumpScale

- Ai, Compliance

- 30 januari 2026

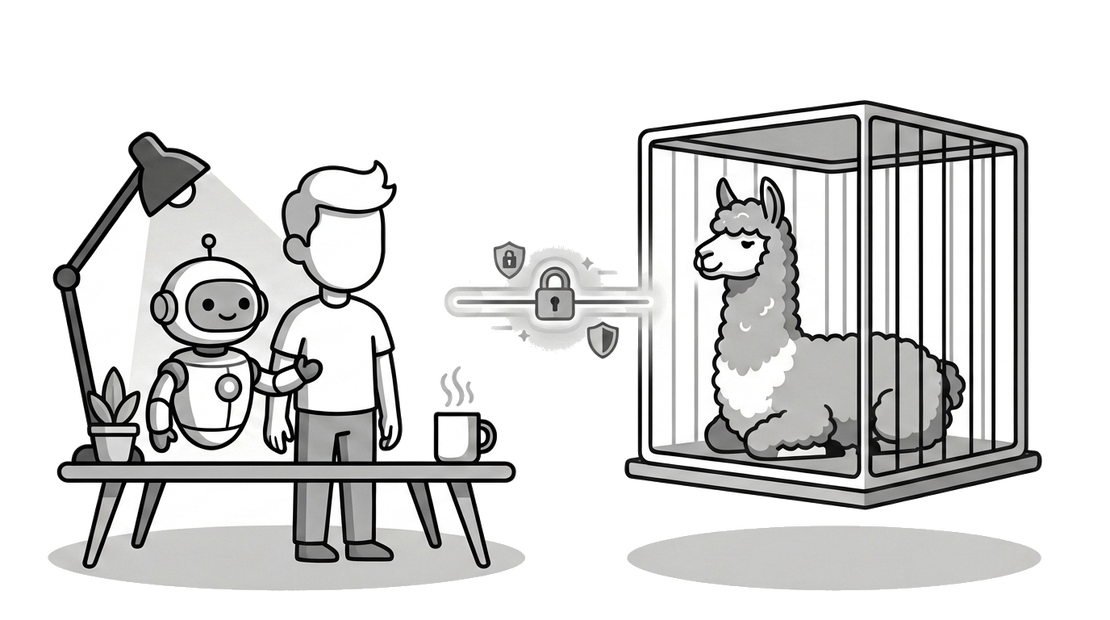

175.000 Ollama-servers staan open op internet door verkeerde configuratie. Dit stappenplan laat zien hoe je lokale LLMs veilig installeert - zodat jouw server niet het volgende doelwit wordt.

Inhoudsopgave

Je wilt experimenteren met een lokale LLM. Logisch - het is goedkoper, je data blijft binnen, en je leert hoe deze technologie werkt. Maar doe je het verkeerd, dan staat je AI-server binnen een uur open voor het hele internet.

Dat is geen overdrijving. Onderzoekers van SentinelOne ontdekten dat 175.000 Ollama-servers precies zo bereikbaar zijn. Open, zonder wachtwoord, klaar voor misbruik.

Dit is het stappenplan om dat te voorkomen. We draaien zelf Ollama voor gevoelige documentanalyse, het is onderdeel van onze aanpak om AI-native te worden.

175.000 Ollama servers onbeveiligd: wat ging er mis?

De onderzoekers van SentinelOne vonden 175.000 Ollama-installaties die publiek bereikbaar zijn. Verspreid over 130 landen, met China (30%), de VS en Duitsland als koplopers.

Het patroon is steeds hetzelfde: iemand installeert Ollama, wil er vanaf een andere machine bij kunnen, past de configuratie aan, en vergeet dat die machine nu bereikbaar is voor het hele internet.

Bijna de helft van deze servers ondersteunt “tool calling” - de mogelijkheid voor de LLM om code uit te voeren en externe systemen aan te roepen. Dat betekent dat aanvallers niet alleen je rekenkracht kunnen misbruiken, maar potentieel toegang krijgen tot je netwerk.

De ironie: Ollama is standaard veilig geconfigureerd. Het luistert alleen op localhost. Pas als je die instelling aanpast, ontstaat het probleem.

Stap 1: Ollama op localhost houden

Ollama luistert standaard op 127.0.0.1:11434. Dat betekent: alleen je eigen machine kan erbij. Niet je thuisnetwerk, niet het internet. Alleen jij.

Laat dit zo.

De verleiding is groot om OLLAMA_HOST=0.0.0.0 in te stellen zodat je er vanaf je laptop bij kunt terwijl het op je server draait. Doe dit niet. Er zijn betere oplossingen - daarover zo meer.

Wat je wel kunt doen

- Bind aan localhost:

OLLAMA_HOST=127.0.0.1:11434 - Of bind aan je Tailscale IP (zie stap 3):

OLLAMA_HOST=100.x.x.x:11434

Wat je nooit doet

OLLAMA_HOST=0.0.0.0- dit opent de poort voor alle interfaces- Port forwarding in je router naar poort 11434

- Firewall-regels die 11434 openzetten voor inkomend verkeer

Waarom dit ertoe doet: dezelfde soort misconfiguraties leidden bij Moltbook tot een lek van 4.75 miljoen records. Open poorten zijn open poorten, of het nu een database of een LLM is.

Stap 2: Firewall als vangnet

Een firewall is je tweede verdedigingslinie. Zelfs als je per ongeluk de verkeerde instelling aanpast, houdt de firewall ongewenst verkeer tegen.

Wat doet een firewall?

Een firewall bepaalt welk netwerkverkeer je computer in en uit mag. Je kunt regels instellen: “blokkeer alles van buitenaf op poort 11434” of “sta alleen verkeer toe van dit specifieke IP-adres”.

De meeste besturingssystemen hebben een ingebouwde firewall. Het enige wat je hoeft te doen is hem aanzetten en de juiste regel toevoegen.

Per besturingssysteem

Linux (Ubuntu/Debian):

sudo ufw enable

sudo ufw deny in 11434

De eerste regel activeert de firewall. De tweede blokkeert al het inkomende verkeer op poort 11434 - de poort waar Ollama op draait.

macOS:

Ga naar Systeeminstellingen → Netwerk → Firewall → Opties. Zet de firewall aan. macOS blokkeert standaard inkomende verbindingen voor apps die niet expliciet zijn toegestaan.

Windows:

Open Windows Firewall (zoek op “firewall” in het startmenu). Klik op “Geavanceerde instellingen” → “Regels voor binnenkomend verkeer” → “Nieuwe regel”. Kies “Poort”, vul 11434 in, en selecteer “Verbinding blokkeren”.

Waarom dit belangrijk is

Stel dat je over zes maanden iets aanpast aan je Ollama-configuratie. Je vergeet dat je daarmee de poort openzet. Zonder firewall staat je server dan direct bloot. Met firewall houdt je vangnet het tegen.

Stap 3: Tailscale voor veilige remote toegang

Hier wordt het interessant. Je wilt Ollama vanaf een andere machine benaderen - je laptop terwijl het op je server draait, of vanaf kantoor terwijl het thuis staat. Hoe doe je dat zonder de poort open te zetten voor het hele internet?

Het antwoord: Tailscale.

Wat is Tailscale?

Tailscale is een tool die een privénetwerk maakt tussen je apparaten. Het werkt als een VPN, maar dan eenvoudiger. Je installeert het op je server en op je laptop, en ze kunnen elkaar direct bereiken via versleutelde verbindingen - zonder dat je iets hoeft te configureren in je router.

Elk apparaat krijgt een eigen IP-adres in het 100.x.x.x-bereik. Die adressen zijn alleen bereikbaar voor andere apparaten in jouw Tailscale-netwerk. Voor de rest van het internet bestaan ze niet.

Waarom Tailscale?

Er zijn meerdere tools die hetzelfde principe gebruiken - een mesh VPN op basis van WireGuard. Alternatieven zijn onder andere ZeroTier, Netbird, en Headscale (een self-hosted variant van Tailscale).

Wij kozen voor Tailscale om twee redenen:

- Gratis tier is ruim genoeg. Tot 100 apparaten en 3 gebruikers zonder te betalen. Voor een MKB-bedrijf of thuisgebruiker is dat meer dan voldoende.

- Configuratie is minimaal. Installeren, inloggen, klaar. Geen handmatige key-exchange, geen port forwarding, geen firewall-regels. Het werkt gewoon.

Als je al ervaring hebt met een van de alternatieven, werkt het principe hetzelfde. Het gaat erom dat je een versleuteld privénetwerk gebruikt in plaats van poorten open te zetten.

Installatie

Op je server (waar Ollama draait):

- Installeer Tailscale via tailscale.com/download

- Run

tailscale upen log in met je account - Noteer het IP-adres dat je krijgt (bijvoorbeeld

100.78.42.15)

Op je laptop/werkstation:

- Installeer Tailscale

- Log in met hetzelfde account

- Je kunt nu de server bereiken via het 100.x.x.x-adres

Ollama configureren voor Tailscale

Nu pas je Ollama aan om te luisteren op je Tailscale-adres:

export OLLAMA_HOST=100.78.42.15:11434

Of voeg dit toe aan je .bashrc of .zshrc om het permanent te maken.

Ollama is nu bereikbaar vanaf al je Tailscale-apparaten, maar onzichtbaar voor het publieke internet. Je hebt geen port forwarding nodig, geen firewall-uitzonderingen, geen gedoe.

Waarom dit beter is dan port forwarding

| Port forwarding | Tailscale |

|---|---|

| Opent een poort voor het hele internet | Alleen jouw apparaten kunnen erbij |

| Vereist handmatige firewall-configuratie | Werkt automatisch door NAT heen |

| Eén verkeerde instelling = blootgesteld | Veilig by default |

| Geen encryptie (tenzij je het zelf regelt) | Altijd versleuteld |

Wat je niet moet doen: Tailscale Funnel

Tailscale heeft een feature genaamd “Funnel” waarmee je services publiek kunt maken via internet. Gebruik dit niet voor Ollama. Funnel is bedoeld voor websites die je wilt delen, niet voor AI-servers die je wilt beschermen.

Stap 4: Reverse proxy met authenticatie (optioneel)

Dit is een geavanceerde stap. Alleen relevant als je Ollama wilt delen met anderen - bijvoorbeeld collega’s of een applicatie die je bouwt.

Wat is een reverse proxy?

Een reverse proxy is een tussenlaag tussen de buitenwereld en je applicatie. Verkeer komt eerst bij de proxy, die checkt of het legitiem is, en stuurt het dan door naar Ollama.

Denk aan een receptionist die bezoekers controleert voordat ze het gebouw in mogen.

Wanneer heb je dit nodig?

- Je wilt Ollama delen met teamleden die niet in je Tailscale-netwerk zitten

- Je bouwt een applicatie die Ollama als backend gebruikt

- Je wilt logging en rate limiting (begrenzing van het aantal verzoeken)

Als je Ollama alleen voor jezelf gebruikt via Tailscale, kun je deze stap overslaan.

Hoe werkt het?

Je zet een webserver (Nginx of Caddy) voor Ollama die om een wachtwoord vraagt. Zonder juiste credentials kom je er niet in.

# Nginx voorbeeld - vraagt om wachtwoord

location /ollama/ {

auth_basic "Ollama";

auth_basic_user_file /etc/nginx/.htpasswd;

proxy_pass http://127.0.0.1:11434/;

}

Caddy maakt het nog simpeler met automatische HTTPS. Maar voor de meeste thuisgebruikers is Tailscale voldoende en een stuk eenvoudiger.

Stap 5: Ollama en systeem up-to-date houden

Een veilige setup blijft alleen veilig als je hem onderhoudt.

Updates installeren

Ollama krijgt regelmatig updates met bugfixes en beveiligingspatches. Check maandelijks of je de laatste versie draait:

ollama --version

Updaten doe je door de installer opnieuw te draaien of via je package manager.

Vergeet ook je besturingssysteem niet. Veel kwetsbaarheden zitten niet in Ollama zelf, maar in de onderliggende software.

Controleer je eigen setup

Eens per kwartaal: check of je configuratie nog klopt.

- Staat

OLLAMA_HOSTnog op localhost of Tailscale? - Draait je firewall nog?

- Zijn er poorten opengezet die je vergeten bent?

Een snelle test: vraag iemand buiten je netwerk om je publieke IP te scannen op poort 11434. Die poort zou onbereikbaar moeten zijn. Denk ook na over welke tools je naast Ollama gebruikt: 12% van AI skills blijkt malicious, een kwetsbaarheid in een skill kan je hele setup ondermijnen. En wie er met die tools werkt: Gen Z adopteert AI sneller, maar heeft dezelfde security-begeleiding nodig.

Ollama security checklist

Snelle controle of je setup veilig is:

- Ollama luistert op localhost (

127.0.0.1) of Tailscale IP (100.x.x.x) - Firewall staat aan en blokkeert poort 11434 voor inkomend verkeer

- Geen port forwarding naar 11434 in je router

- Remote toegang gaat via Tailscale, niet via open poorten

- Tailscale Funnel staat uit voor Ollama

- Software is up-to-date (Ollama, OS, Tailscale)

Alles aangevinkt? Dan maak je geen deel uit van die 175.000 blootgestelde servers.

Zelf bezig met AI-infrastructuur in je bedrijf? Laten we praten over hoe je dat veilig aanpakt.